(VOVWORLD) -

ໃນປີ 2023 ນີ້, ປັນຍາປະດິດ (AI) ພົ້ນເດັ່ນຂຶ້ນກາຍເປັນໜຶ່ງໃນບັນດາບັນຫາມີລັກສະນະທົ່ວໂລກ. ພ້ອມກັບຄວາມສາມາດບົ່ມຊ້ອນຂອງການໝູນໃຊ້ຢ່າງກ້ວາງຂວາງໃນຊີວິດສັງຄົມ - ເສດຖະກິດ ຂອງບັນດາປະເທດ, AI ກໍ່ມີຄວາມສ່ຽງສູງທາງດ້ານຄວາມໝັ້ນຄົງ, ຄວາມປອດໄພ, ບັງຄັບໃຫ້ບັນດາປະເທດ ແລະ ອົງການຈັດຕັ້ງສາກົນຕ້ອງຊອກຫາມາດຕະການຄວບຄຸມ.

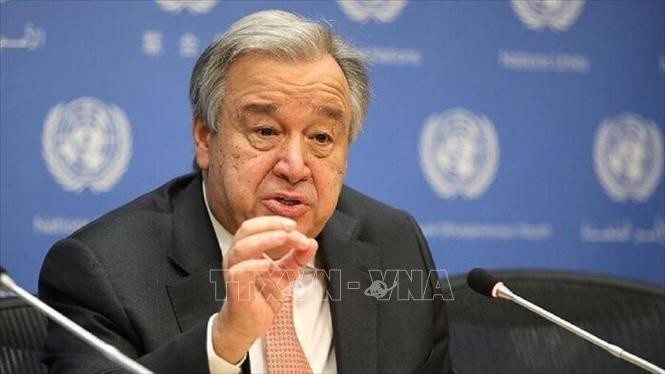

ທ່ານ Antonio Guterres, ເລຂາທິການໃຫຍ່ ສປຊ ທ່ານ Antonio Guterres, ເລຂາທິການໃຫຍ່ ສປຊ(ພາບ:IRNA/TTXVN)

|

ວັນທີ 1 ພະຈິກ, ຄຳສັບ AI, ເຊິ່ງເປັນຄຳຂຽນຫຍໍ້ຂອງປັນຍາປະດິດ, ໂດຍສຳນັກພິມຈຳໜ່າຍວັດຈະນານຸກົມຊື່ດັງ Collins (ປະເທດ ອັງກິດ) ໄດ້ເລືອກເຟັ້ນເປັນຄີເວີດ (key word ຄຳໃຊ້ໃນການຄົ້ນຫາ) ຂອງປີນີ້. ເພື່ອອະທິບາຍກ່ຽວກັບການເລືອກເຟັ້ນນີ້, ບັນດານັກຊ່ຽວຊານດ້ານພາສາຂອງ Collins ໃຫ້ຮູ້ວ່າ: ຄີເວີດ ດ້ານເຕັກໂນໂລຊີນີ້ ໄດ້ຮັບການນຳໃຊ້ຢ່າງກ້ວາງຂວາງ, ພ້ອມທັງກາຍເປັນ “ຫົວເລື່ອງປຶກສາຫາລືຕົ້ນຕໍຂອງປີ”, ດ້ວຍພະຍານຫຼັກຖານທີ່ຊວນເຊື່ອທີ່ສຸດ, ນັ້ນແມ່ນການນຳໃຊ້ຄຳສັບ AI ເພີ່ມຂຶ້ນທົບ 4 ເທົ່າໃນປີນີ້.

ຄວາມສາມາດບົ່ມຊ້ອນໃນການໝູນໃຊ້ອັນໃຫຍ່ຫຼວງຂອງ AI

ການເປີດຕົວ ແລະ ສ້າງຄວາມສັ່ນສະເທືອນໃນທົ່ວໂລກຂອງ ChatGPT ໃນຕົ້ນປີນີ້, ຊອບແວ AI ຂອງບໍລິສັດ OpenAI, ໄດ້ຮັບຖືວ່າແມ່ນຂີດໝາຍໃນການປ່ຽນແປງສະຕິຄວາມຮັບຮູ້ຂອງຫຼາຍຄົນກ່ຽວກັບ AI ຍ້ອນວ່າ ChatGPT ພ້ອມກັບບັນດາຄູ່ແຂ່ງອື່ນໆ, ຄື: Gemini ຂອງ Google DeepMind ຫຼື Grok AI ຂອງເສດຖິເງິນຕື້ Elon Musk ໄດ້ເປັນຂີດໝາຍການເລີ່ມຕົ້ນຂອງສັງກະລາດຫັນພູມປັນຍາເປັນ AI. ນີ້ບໍ່ພຽງແຕ່ແມ່ນບັນດາ ແອັບພິເຄຊັນ ເຕັກໂນໂລຊີ ຮັບໃຊ້ຄວາມຕ້ອງການຂອງຜູ້ນຳໃຊ້ເທົ່ານັ້ນ ຫາກນີ້ໄດ້ພັດທະນາຢູ່ໃນລະດັບສູງກ່ວາ, ນັ້ນແມ່ນເລີ່ມມີ “ຈິນຕະນາການໃນເບື້ອງຕົ້ນ” ຢ່າງເປັນເຈົ້າການ, ມີຄວາມສາມາດເຊື່ອມຕໍ່ Big data, ພັດທະນາຄວາມຮູ້ເອງ ແລະ ພັດທະນາຄວາມກ້າວໜ້າຜ່ານການກະທົບຕອບກັບຜູ້ນຳໃຊ້. ຕາມທ່ານ Antonio Guterres, ເລຂາທິການໃຫຍ່ ສປຊ ແລ້ວ, ຖ້າໄດ້ຮັບການນຳໃຊ້ຢ່າງມີຄວາມຮັບຜິດຊອບ ແລະ ຍຸຕິທຳນັ້ນ, AI ອາດຈະສ້າງຂອດບຸກທະລຸໃນເສັ້ນທາງການພັດທະນາຂອງແຕ່ລະປະເທດ:

“AI ສາມາດຊຸກຍູ້ການກະທຳເພື່ອດິນຟ້າອາກາດ ແລະ ບັນດາຄວາມມານະພະຍາຍາມປະຕິບັດ 17 ເປົ້າໝາຍພັດທະນາແບບຍືນຍົງໃນປີ 2030 ຢ່າງແຮງ. ແຕ່ທັງໝົດສິ່ງເຫຼົ່ານີ້ໄດ້ອີງໃສ່ເລື່ອງບັນດາເຕັກໂນໂລຊີ AI ໄດ້ຮັບການລະດົມຢ່າງມີຄວາມຮັບຜິດຊອບ, ແລະ ມີຄວາມສາມາດໃນການເຂົ້າເຖິງກັບທຸກໆປະເທດ, ລວມທັງບັນດາປະເທດພວມພັດທະນາ, ເຊິ່ງ ເປັນບັນດາປະເທດຕ້ອງການເຕັກໂນໂລຊີນີ້ທີ່ສຸດ”.

ໃນລະດັບທົ່ວໂລກ, AI ໄດ້ເລີ່ມຜັນຂະຫຍາຍເພື່ອສ້າງບັນດາຮູບແບບການຄາດຄະເນໂລກພະຍາດຄັ້ງໃໝ່, ໄດ້ເຂົ້າຮ່ວມກັບບັນດາການບໍລິການການແພດ, ພະຍາກອນການຜັນແປຂອງອາກາດ, ພັດທະນາແນວພັນປູກທີ່ມີຄວາມສາມາດປັບຕົວກັບການປ່ຽນແປງຂອງດິນຟ້າອາກາດ, ຈາກນັ້ນ ກໍ່ສ້າງລະບົບສະບຽງອາຫານທົ່ວໂລກໃໝ່ແບບທີ່ຍືນຍົງກ່ວາ.

(ພາບປະກອບຈາກ CCO) (ພາບປະກອບຈາກ CCO)

|

ພັດທະນາ AI ແບບມີຄວາມຮັບຜິດຊອບເພື່ອຈຳກັດຄວາມສ່ຽງ

ຄຽງຄູ່ກັບບັນດາຜົນປະໂຫຍດດ້ານຄວາມສາມາດບົ່ມຊ້ອນຢ່າງໃຫຍ່ຫຼວງ, AI ກໍ່ ເລີ່ມສ້າງຄວາມວິຕົກວັງວົນ. ຕໍ່ໜ້າການພັດທະນາຢ່າງວ່ອງໄວຂອງບັນດາເຕັກໂນໂລຊີ AI ໃນປີນີ້, ບັນດາປະເທດ, ອົງການຈັດຕັ້ງສາກົນ ກໍ່ຄືບັນດານັກຊ່ຽວຊານເຕັກໂນໂລຊີ ນັບມື້ນັບມີສະຕິຕໍ່ບັນດາຄວາມສ່ຽງເຊິ່ງ AI ສ້າງຂຶ້ນຕໍ່ຄວາມໝັ້ນຄົງແຫ່ງຊາດ, ຄວາມສະຖຽນລະພາບຂອງສັງຄົມ ແລະ ຍິ່ງກ່ວານັ້ນແມ່ນຄວາມປອດໄພຂອງມວນມະນຸດ.

ໃນກາງປີ 2023 ນີ້, ຜູ້ອຳນວຍການດ້ານບໍລິຫານ (CEO) ຂອງບັນດາບໍລິສັດ AI ແຖວໜ້າຂອງໂລກ ພ້ອມກັບນັກຄົ້ນຄ້ວາ ແລະ ນັກຊ່ຽວຊານນັບຮ້ອຍທ່ານ ໄດ້ພ້ອມກັນລົງລາຍເຊັນເຂົ້າໃນຖະແຫຼງການສະບັບໜຶ່ງ, ໂດຍເນັ້ນໜັກເຖິງການຫລຸດຜ່ອນຄວາມສ່ຽງຈາກ AI ຕ້ອງແມ່ນບຸລິມະສິດທົ່ວໂລກ, ພ້ອມທັງໄດ້ເວົ້າວ່າການກະທຳນີ້ມີລັກສະນະຮີບດ່ວນຄືດັ່ງເລື່ອງສະກັດກັ້ນສົງຄາມນິວເຄຼຍ. ເສດຖີເງິນຕື້ ຊາວ ອາເມລິກາ ທ່ານ Elon Musk, ໜຶ່ງໃນບັນດາຜູ້ນຳໜ້າໃນການພັດທະນາເຕັກໂນໂລຊີ AI, ກໍ່ໄດ້ອອກສຽງກ່າວເຕືອນກ່ຽວກັບໄພອັນຕະລາຍຂອງເຕັກໂນໂລຊີນີ້ ຖ້າບໍ່ໄດ້ການຄວບຄຸມຢ່າງເຂັ້ມງວດ:

“ຂ້າພະເຈົ້າຄິດວ່າ, ມີໄລຍະເວລາໜຶ່ງ ທີ່ຫາງສຽງມີຄວາມປະເອີບໃຈກ່ຽວກັບເຕັກໂນໂລຊີ AI. ຂ້າພະເຈົ້າເວົ້າສິ່ງດັ່ງກ່າວດ້ວຍຖານະເປັນນັກວິສາວະກອນ ດັ່ງນັ້ນຈິ່ງເຂົ້າໃຈແຈ້ງບັນຫານັ້ນ. ຖ້າຕ້ອງຕີລາຄາ, ຂ້າພະເຈົ້າຖືວ່າ ສ່ວນຫຼາຍ AI ແມ່ນແຫຼ່ງກຳລັງທີ່ດີ ແຕ່ຄວາມສາມາດກາຍເປັນເຕັກໂນໂລຊີທີ່ບໍ່ດີຕ້ອງແມ່ນ 0%. ດັ່ງນັ້ນ ພວກເຮົາຕ້ອງຫລຸດຜ່ອນບັນດາຄວາມສ່ຽງຂອງເຕັກໂນໂລຊີນີ້”.

ຕໍ່ໜ້າບັນດາສິ່ງທ້າທາຍກ່ຽວກັບເລື່ອງ AI ອາດຈະພັດທະນາໂດຍບໍ່ສາມາດຄວບຄຸມໄດ້ ແລະ ສົ່ງຜົນກະທົບຫຍໍ້ທໍ້ເຖິງມະນຸດນັ້ນ, ປະຊາຄົມໂລກໃນປີນີ້ໄດ້ເພີ່ມທະວີໃນການຄວບຄຸມການພັດທະນາ ແລະ ນຳໃຊ້ AI. ຕົ້ນເດືອນພະຈິກນີ້, ເປັນຄັ້ງທຳອິດ, ກອງປະຊຸມສຸດຍອດທົ່ວໂລກ ກ່ຽວກັບຄວາມປອດໄພຂອງ AI ໄດ້ຈັດຂຶ້ນຢູ່ປະເທດ ອັງກິດ, ເຊິ່ງໄດ້ຮັບຮອງເອົາຖະແຫຼງການ Bletchley ດ້ວຍການປະກອບລາຍເຊັນຂອງຜູ້ຕາງໜ້າ 27 ປະເທດ, ໃນນັ້ນ, ມີບັນດາປະເທດຄວບຄຸມ AI ແຖວໜ້າຂອງໂລກ, ຄື: ອາເມລິກາ, ຈີນ, ສະຫະພາບເອີລົບ (EU), ໃຫ້ຄຳໝັ້ນສັນຍາຊຸກຍູ້ນ້ຳໃຈຄວາມຮັບຜິດຊອບສູງ ແລະ ການຮ່ວມມືສາກົນໃນການນຳໃຊ້ ແລະ ຄົ້ນຄ້ວາ AI ໃຫ້ປອດໄພ. ກໍ່ຈາກກອງປະຊຸມນີ້, ບັນດາປະເທດໄດ້ວາງອອກຫຼັກການຄວບຄຸມ AI “ປອດໄພຈາກການອອກແບບ” ຫຼື ເລື່ອງບັນດານັກພັດທະນາ AI ໃຫ້ຄຳໝັ້ນສັນຍາອະນຸຍາດໃຫ້ບັນດາລັດຖະບານກວດກາຄວາມປອດໄພຂອງບັນດາເຕັກໂນໂລຊີ AI ກ່ອນທີ່ຈະປະກາດໃຫ້ມະຫາຊົນ.

ບັນດາກົນໄກຄວບຄຸມ AI ອື່ນກໍ່ໄດ້ກຳເນີດໃນປີນີ້. ທ້າຍເດືອນຕຸລາ ຜ່ານມາ, ສປຊ ໄດ້ປະກາດຄະນະທີ່ປຶກສາ AI, ດ້ວຍສະມາຊິກ 39 ຄົນ ເຊິ່ງເປັນບັນດາຜູ້ອຳນວຍການໃຫຍ່ບໍລິສັດ, ເຈົ້າໜ້າທີ່ລັດຖະບານ ແລະ ບັນດານັກຮຽນຮູ້, ມີໜ້າທີ່ຍົກອອກທິດຄຸ້ມຄອງ AI ຢູ່ລະດັບສາກົນ.

ຢູ່ລະດັບແຫ່ງຊາດ, ທັງ ອາເມລິກາ ແລະ ອັງກິດ ລ້ວນແຕ່ສ້າງຕັ້ງບັນດາສະຖາບັນຄວາມປອດໄພ AI ເພື່ອແນໃສ່ຕີລາຄາ ແລະ ທົດລອງບັນດາຮູບແບບໃໝ່, ຜ່ານນັ້ນກໍ່ກຳນົດໄດ້ທຸກໆຄວາມສ່ຽງຈາກ AI. ໃນຂະນະນັ້ນ, ຈີນ ກໍ່ໄດ້ປະກາດ “ຂໍ້ລິເລິ່ມບໍລິຫານ AI ທົ່ວໂລກ”, ເຊິ່ງຍົກອອກບາງຂໍ້ກຳນົດຊົ່ວຄາວສຳລັບ AI. ນອກຈາກນັ້ນ, ກຸ່ມບໍລິສັດ ແລະ ອົງການຈັດຕັ້ງສາກົນກ່ວາ 50 ແຫ່ງ ກໍ່ໄດ້ສ້າງຕັ້ງສະຫະພັນ AI ແມ່ ເພື່ອແນໃສ່ຮັບປະກັນວິທີການຮ່ວມມືຢ່າງເປີດເຜີຍ ແລະ ກະຈ່າງແຈ້ງກ່ວາໃນການພັດທະນາເຕັກໂນໂລຊີນີ້./.